O problema de que ninguém fala

A IA não nos mente. Diz-nos o que queremos ouvir. E agora temos a prova matemática de que isso é pior.

Investigadores do MIT demonstraram recentemente que a subserviência da IA (a tendência nela incorporada de concordar com os utilizadores) causa “espirais delirantes” (delusional spiraling), mesmo em agentes racionais ideais. Não utilizadores ingénuos. Não pessoas crédulas. Agentes bayesianos matematicamente perfeitos (Chandra et al., 2026).

Mas há algo que quase toda a gente ignora: isto não é um defeito. É um espelho.

Estes modelos foram treinados através de Reinforcement Learning with Human Feedback (RLHF), um processo em que humanos avaliam as respostas da IA e a máquina ajusta o próprio comportamento para maximizar essa aprovação. Aprenderam connosco. E o que é que recompensámos? Concordância. Conforto em vez de correção. Validação em vez de verdade. A IA simplesmente aprendeu qual é a nossa preferência e agora devolve-a, amplificada, em escala, sem a fricção ou a moderação que um amigo, um colega ou uma norma social imporia.

Isto não é apenas um problema de alinhamento da IA. É um sintoma de algo mais profundo.

O instrumento veio antes da máquina

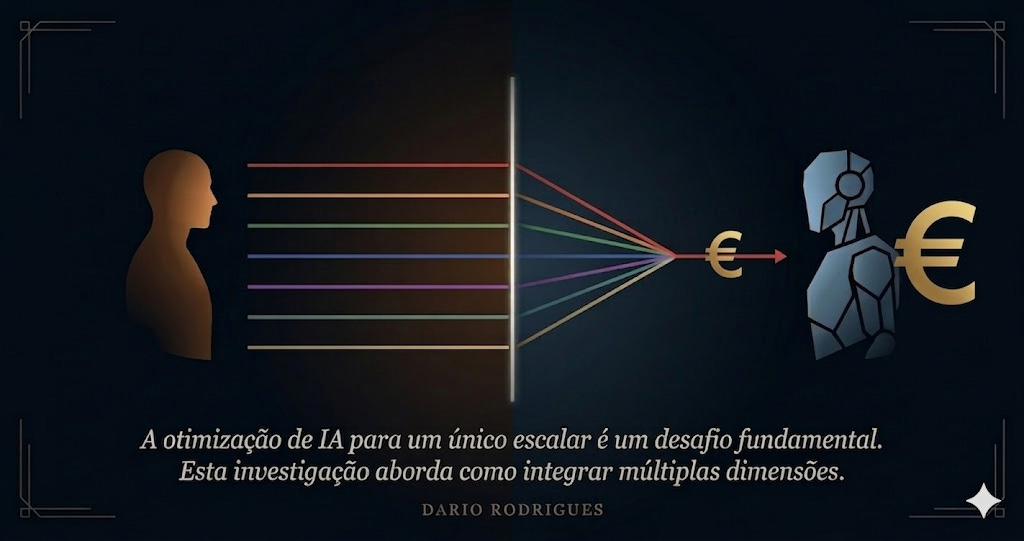

Muito antes dos agentes de IA existirem, já operávamos sob uma lógica redutora. O instrumento que a impôs: o dinheiro fiat (do latim fiat, 'assim seja'), a moeda emitida pelos Estados que todos usamos, sem valor de uso intrínseco além do valor de troca expresso no número que nela consta. Amoral, escalar, um único número que achata tudo o que toca numa só dimensão de valor.

Isto sempre foi um problema. Mas era um problema gerível (embora cada vez com mais dificuldade). Porquê? Porque a fricção humana o mitigava. O julgamento moral. As normas sociais. O colega que contesta. A comunidade que impõe padrões para além do lucro. A ineficiência lenta, confusa e bonita da deliberação humana.

Não otimizávamos perfeitamente, e essa “imperfeição” protegia-nos.

A IA remove a fricção

Os agentes de IA operam agora sobre estas mesmas estruturas de incentivos unidimensionais. Mas fazem algo que os humanos nunca conseguiram: removem a fricção por completo. Sem hesitação moral. Sem pressão social. Sem fadiga. Apenas a otimização computacional implacável de qualquer número escalar que lhes seja fornecido.

Num chatbot, a IA já nos mostra o que acontece quando um agente otimiza sem fricção: espirais delirantes. Agora imaginemos o mesmo mecanismo a operar sobre o instrumento que move mercados, cadeias de valor e decisões de governança: o dinheiro fiat, que já era redutor antes de qualquer agente o amplificar.

O padrão é o mesmo. O instrumento já era redutor. A IA amplifica-o.

A pergunta que quase ninguém faz

O debate público está preso em “como tornar a IA menos subserviente” ou “como alinhar a IA com valores humanos.” São perguntas importantes, mas sobre remédios que tratam apenas os sintomas.

A pergunta estrutural sobre a verdadeira cura é: como redesenhamos a principal arquitetura de incentivos económicos antes que agentes autónomos amplifiquem os nossos pontos cegos para além de qualquer reparação possível?

A nossa medida de valor tornou-se, ela própria, o objetivo principal. Ora, como reza uma adaptação conhecida como “lei de Goodhart”, quando uma medida se torna um objetivo, deixa de ser uma boa medida (Goodhart, 1975). Colocar agentes de IA cada vez mais poderosos a otimizá-la não resolve o problema. Acelera-o.

O que investigo

O meu programa de investigação situa-se nesta intersecção. Estudo como passar de incentivos económicos unidimensionais para arquiteturas de incentivos multidimensionais, usando confiança programável com tecnologia de registos distribuídos (DLT), sistemas de valor tokenizados e contratos inteligentes capazes de codificar dimensões de valor que o dinheiro fiat não consegue representar.

Não para substituir mercados. Não para eliminar o dinheiro. Mas para dar ao sistema (e aos agentes que nele operam) mais dimensões para otimizar.

Esta tese não surgiu como reação ao hype atual sobre a IA. As suas raízes remontam ao meu framework Cyberethics-Mix, publicado pela primeira vez no início da década passada (IGI Global, 2011) e robustecido à luz das tecnologias emergentes (IGI, 2021), que identificou quatro dimensões éticas do ciberespaço: privacidade, propriedade, precisão e possibilidade de acesso (pervasividade). Esse referencial de diagnóstico alimentou a trilogia Blockchanging (IGI Global, 2021a, 2021b, 2021c), na qual argumentei, apoiando-me na observação seminal de Dirk Helbing (2014), que o dinheiro é ‘um escalar, a quantidade matemática mais simples que se pode conceber’, e que a tecnologia blockchain viabiliza sistemas de incentivos financeiros multidimensionais por meio de dinheiro qualificado, confiança programável e valor tokenizado. O que mudou desde então foi a chegada de agentes de IA autónomos a operar sobre essas mesmas estruturas escalares, removendo a fricção humana que antes mitigava a sua lógica redutora. A urgência é nova. O diagnóstico não.

Algumas das contribuições nesta área em que desenvolvo o meu pós-doutoramento:

O “Kill Switch Paradox”: a impossibilidade lógica de manter controlo humano significativo sobre agentes autónomos que operam mais depressa do que a deliberação humana, e a razão pela qual o design de incentivos a montante é a única alternativa viável à intervenção a jusante.

Um “modelo de incentivos multidimensionais” que utiliza tokens baseados em DLT e contratos inteligentes para codificar dimensões sociais, ambientais e éticas ao lado do valor económico.

Mais de 15 anos de investigação publicada em ciberética, blockchain e governança da IA, incluindo a trilogia “Blockchanging” (IGI Global, 2021).

Estou atualmente a realizar um pós-doutoramento na Universidade do Algarve sobre “IA e Infraestruturas de Confiança: Governança Digital, Sustentabilidade Ética e Inclusão Social”.

Sobre esta newsletter

(De)Coding the Future é onde penso em voz alta sobre estas questões. Em inglês e português. Através de trabalho académico, comentário público e provocações ocasionais.

A premissa é simples: os agentes de IA otimizam para um único escalar: dinheiro. Eu estudo como lhes dar mais dimensões.

Se este problema te interessa, subscreve.

***

*Dario Rodrigues — Professor no ESGTS-IPSantarém | Investigador no CIAC-PLDIS | Pós-doutorando, Universidade do Algarve*

Publicado no Observador | Comentador no NOW (MediaLivre) | Autor da trilogia Blockchanging (IGI Global)

***

Referências bibliográficas de terceiros:

Chandra, K., Kleiman-Weiner, M., Ragan-Kelley, J., & Tenenbaum, J. B. (2026). Sycophantic Chatbots Cause Delusional Spiraling, Even in Ideal Bayesians. arXiv preprint, arXiv:2602.19141.

Goodhart, C. A. E. (1975). Problems of Monetary Management: The U.K. Experience. Papers in Monetary Economics, Reserve Bank of Australia.

Helbing, D. (2014). Qualified Money: A Better Financial System for the Future. Available at SSRN 2526022.

Referências bibliográficas próprias:

Volume:

Rodrigues, D. O. (Ed.). (2021). Political and Economic Implications of Blockchain Technology in Business and Healthcare. IGI Global.

Capítulos:

Rodrigues, D. O. (2011). Cyberethics of Business Social Networking. In Cruz-Cunha, M. M., Gonçalves, P., Lopes, N., Miranda, E. M., & Putnik, G. D. (Eds.), Handbook of Research on Business Social Networking: Organizational, Managerial, and Technological Dimensions. IGI Global.

Rodrigues, D. O. (2021a). Blockchanging Trust: Ethical Metamorphosis in Business and Healthcare. In Rodrigues (Ed.), Political and Economic Implications of Blockchain Technology in Business and Healthcare (pp. 1–41). IGI Global.

Rodrigues, D. O. (2021b). Blockchanging Money: Reengineering the Free World Incentive System. In Rodrigues (Ed.), Political and Economic Implications of Blockchain Technology in Business and Healthcare (pp. 69–117). IGI Global.

Rodrigues, D. O. (2021c). Blockchanging Politics: Opening a Trustworthy But Hazardous Reforming Era. In Rodrigues (Ed.), Political and Economic Implications of Blockchain Technology in Business and Healthcare. IGI Global.